NVIDIA扩大AI推理性能领先优势,首次在Arm服务器上取得佳绩

【慧聪通信网】根据今日发布的基准测试结果,NVIDIA在使用x86及Arm CPU进行AI推理时取得了最佳成绩。

这是NVIDIA连续第三次在MLCommons推理测试中创造性能和能效纪录。MLCommons是一家成立于2018年5月的行业基准测试组织。

这场测试是第一次在Arm系统上进行数据中心类别的测试,这使用户在部署AI这一目前最具变革性的技术时有了更多的选择。

无与伦比的性能

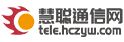

在最新一轮测试中,由NVIDIA AI平台驱动的系统在所有七项推理性能测试中都名列前茅,这些系统来自NVIDIA和其九家生态系统合作伙伴,包括阿里巴巴、戴尔科技、富士通、技嘉、慧与、浪潮、联想、宁畅和超微。

NVIDIA是唯一一家在本轮和迄今为止每一轮测试中取得所有MLPerf测试结果的公司。

推理(Inference)指计算机通过运行AI软件来识别对象或进行预测。在这个过程中,计算机使用深度学习模型来过滤数据,进而发现人类所无法捕捉的结果。

MLPerf推理基准测试基于当今最常用的AI工作负载和场景,涵盖计算机视觉、医学影像、自然语言处理、推荐系统、强化学习等。

因此,无论用户部署何种AI应用,都可以通过NVIDIA创造自己的纪录。

为什么性能十分重要

随着AI用例从数据中心扩展到边缘和其他领域,AI模型和数据集将不断增加。就是为什么用户需要既可靠又能灵活部署的性能。

MLPerf让用户有信心做出明智的购买决定。该组织得到了几十家行业领导者的支持,包括阿里巴巴、Arm、百度、谷歌、英特尔和NVIDIA,因此这些测试是透明的和客观的。

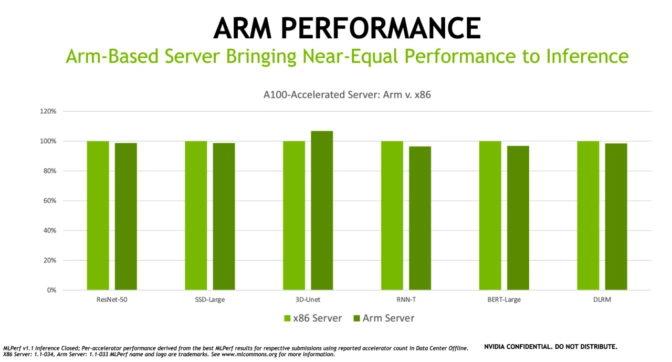

将Arm灵活应用于企业AI

凭借在能效性能上的不断增长和不断扩展的软件生态系统,Arm架构正在向全球各地的数据中心进军。

最新基准测试表明,作为GPU加速的平台,在AI推理工作中,使用Ampere Altra CPU的Arm服务器与具有类似配置的X86服务器提供的性能几乎相同。事实上,在其中的一项测试中,Arm服务器的性能甚至超过了类似配置的x86系统。

NVIDIA一直以来支持所有类型的CPU架构,十分高兴地看到Arm在同行评审的行业基准测试中能够证明其AI性能。

Arm高性能计算和工具高级总监David Lecomber表示:“作为MLCommons的创始成员,Arm致力于通过创建标准和基准来更好地应对挑战并激发加速计算行业的创新。”

“最新推理结果表明,Arm CPU和NVIDIA GPU驱动的Arm系统已能够应对数据中心中的各种AI工作负载。”

NVIDIA合作伙伴展示其AI性能

NVIDIA AI技术得到了广大和日益扩展的生态系统的支持。

在最新基准测试中,七家OEM厂商共提交了22个GPU加速的平台。

这些服务器中的大多数型号都是NVIDIA认证系统,经验证可以运行多种加速工作负载,而且其中很多型号都支持上个月正式发布的NVIDIA AI Enterprise软件。

参与本轮测试的合作伙伴包括戴尔科技、富士通、慧与、浪潮、联想、宁畅、超微以及云服务提供商阿里巴巴。

软件的力量

NVIDIA能够在所有AI用例中取得成功的一个关键因素是其完整的软件栈。

在推理方面,这包括针对各种用例的预训练AI模型。NVIDIA TAO Toolkit运用迁移学习为特定应用定制这些模型。

NVIDIA TensorRT软件对AI模型进行了优化,使其能够最有效地运用内存并且实现更快的运行速度。NVIDIA经常使用该软件进行MLPerf测试,该软件可用于X86和Arm的系统。

在这些基准测试中,NVIDIA还采用了NVIDIA Triton 推理服务器软件和多实例GPU(MIG)功能。它们为所有开发者提供了通常需要专家级程序员才能实现的性能。

随着该软件栈的不断改进,与四个月前的MLPerf推理基准测试相比,NVIDIA提升了高达20%的性能和15%的能效。

NVIDIA在最新测试中所使用的所有软件都可以从MLPerf资源库中获得,因此任何人都可以重现NVIDIA的基准测试结果。NVIDIA会陆续将这些代码添加到NVIDIA的深度学习框架和容器中,用户可在NVIDIA的GPU应用软件中心NGC上获得这些框架和容器。

其作为全栈式AI平台的一部分,支持所有主要的处理器架构,已在最新行业基准测试中得到了验证,并可通过多家合作伙伴获取,助力客户应对当今的实际AI工作任务。